�l(f��)���r(sh��)�g��2022-04-29���ٷ������Փ���g�[��1��

ժ Ҫ�� ժ Ҫ: (li��n)��W(xu��)��(x��)��협�(y��ng)��(sh��)��(j��)�r(sh��)�����˹����ܼ��g(sh��)�l(f��)չ���d���һ�N�f(xi��)�{(di��o)����(g��)���c����ͬӖ(x��n)��ģ�͵ęC(j��)��. �����S����(g��)���c������(sh��)��(j��)�����ڱ���, �ڴ��Ɣ�(sh��)��(j��)�u��ͬ�r(sh��)���C���c����(du��)��(sh��)��(j��)�Ŀ��ƙ�(qu��n). Ȼ��(li��n)��W(xu��)��(x��)�����˴�������(sh��)���Q�^��, ���H�ͼ���ʽӖ(x��n)��һ���ܵ�ģ��ʹ���ߵ���

����ժ Ҫ: (li��n)��W(xu��)��(x��)��협�(y��ng)��(sh��)��(j��)�r(sh��)�����˹��������g(sh��)�l(f��)չ���d���һ�N�f(xi��)�{(di��o)����(g��)���c����ͬӖ(x��n)��ģ�͵ęC(j��)��. �����S����(g��)���c������(sh��)��(j��)�����ڱ���, �ڴ��Ɣ�(sh��)��(j��)�u��ͬ�r(sh��)���C���c����(du��)��(sh��)��(j��)�Ŀ��ƙ�(qu��n). Ȼ��(li��n)��W(xu��)��(x��)�����˴�������(sh��)���Q�^��, ���H�ͼ���ʽӖ(x��n)��һ���ܵ�ģ��ʹ���ߵ����{, ߀�����ܵ����Բ����ŵą��c�O(sh��)��Ĺ���, ���ؽ�����(qi��ng)���[˽�ֶα��o(h��)�������еĔ�(sh��)��(j��). ������չ����(li��n)��W(xu��)��(x��)�е��[˽���o(h��)���g(sh��)���о��M(j��n)չ��څ��. ��Ҫ��B(li��n)��W(xu��)��(x��)�ļܘ�(g��u)�����, ����(li��n)��W(xu��)��(x��)�^�������R���[˽�L(f��ng)�U(xi��n), ���Y(ji��)�ؽ����Ɣ��ɷN��������, Ȼ������(j��)(li��n)��W(xu��)��(x��)�е��[˽���o(h��)�C(j��)�ƚw�{�[˽���o(h��)���g(sh��), �������{(di��o)�Б�(y��ng)���������g(sh��)���[˽���o(h��)�㷨, �����ġ����ء������c���ؽY(ji��)���@ 3 ��(g��)���濂�Y(ji��)�F(xi��n)�еı��o(h��)����. ���ӑՓ(li��n)��W(xu��)��(x��)�[˽���o(h��)���R������(zh��n)��չ��δ���İl(f��)չ����.

�����P(gu��n)�I�~: (li��n)��W(xu��)��(x��); �[˽���o(h��); �[˽����; ����[˽; ͬ�B(t��i)����; ��ȫӋ(j��)��

���������, ��(sh��)��(j��)�(q��)��(d��ng)���˹����ܱŰl(f��)������, ���������t(y��)��������Ҏ(gu��)�����Ԅ�(d��ng)�{�ȶ���(g��)�I(l��ng)������˴�Ҏ(gu��)ģ��(f��)�s�΄�(w��)�W(xu��)��(x��). �C(j��)���W(xu��)��(x��)�����˹����ܵĺ��ļ��g(sh��), �����ܺ��[˽��Ҳ�V���P(gu��n)ע. ���y(t��ng)�ęC(j��)���W(xu��)��(x��)��Ҫ�ɷ���(w��)���ռ��Ñ��Ĕ�(sh��)��(j��)����Ӗ(x��n)��, �����Ñ��Ĕ�(sh��)��(j��)�c�Ñ�(g��)�w�o�����P(gu��n), ����ֱ�Ӱ���������Ϣ, �炀(g��)�����g���N�塢������Ϣ��; Ҳ�����g�Ӕy���[����������Ϣ, �炀(g��)�˾W(w��ng)퓞g�[ӛ䛡���(n��i)��ƫ�����[�����Ñ����A��. ����@Щ������Ϣ���ռ��^���б�����(w��)��й¶��������, ��ֱ�����{�Ñ���������ȫ����(g��)�����u(y��)��ؔ(c��i)�a(ch��n)��ȫ. �������(w��)�̛]��ֱ�ӹ��_�Ñ���(sh��)��(j��), ����Ӗ(x��n)����l(f��)����ģ��Ҳ������?y��n)��ܵ��[˽������й¶���cӖ(x��n)���Ĕ�(sh��)��(j��). �S���[˽���}�ܵ����P(gu��n)ע�̶��������, �Ñ����픵(sh��)��(j��)����ԸԽ��Խ��. �c֮ì�ܵ���, �˹����ܼ��g(sh��)�s�������������(sh��)��(j��)�ռ����ں�, ������ܫ@ȡ�����S������Ϣ��Ӗ(x��n)��ģ�Ͳ��l(f��)չ���g(sh��), �˹����ܑ�(y��ng)�õİl(f��)չ���ܵ���(y��n)������.

�����ڔ�(sh��)��(j��)�u�F(xi��n)���c��(sh��)��(j��)�ں������ì����u�@�ı�����, (li��n)��W(xu��)��(x��)(federated learning, FL)��(y��ng)�\(y��n)����. 2017 ��, Google ��˾�״������(li��n)��W(xu��)��(x��)�ĸ���[1], �@��һ�N�ɶ���(g��)��(sh��)��(j��)���з�(���֙C(j��)����(li��n)�W(w��ng)�O(sh��)��, ���߽��ڡ��t(y��)���C(j��)��(g��u)��)�f(xi��)ͬӖ(x��n)��ģ�Ͷ������픵(sh��)��(j��), �H�����g�A�ν��QӖ(x��n)������(sh��)�ČW(xu��)��(x��)�C(j��)��. �����r��, (li��n)��W(xu��)��(x��)�õ��Ĺ���ģ���c��(sh��)��(j��)���������ķ���(w��)����Ӗ(x��n)������ģ�����, Ч����������[2]. �ɴ�, ��I(y��)�܉�ͨ�^�Ϸ��Ҹ�Ч�ķ�ʽ�ںϔ�(sh��)��(j��)��ȡ��Ϣ, ��(g��)�˻��������Д�(sh��)��(j��)�ęC(j��)��(g��u)��Ȼ�܉���������I(y��)�ṩ���˹����ܷ���(w��)��ͬ�r(sh��), ���Д�(sh��)��(j��)�Ŀ��ƙ�(qu��n).

�����M��(li��n)��W(xu��)��(x��)�����ˌ���(sh��)��(j��)ֱ�ӱ�¶�o������, ��(du��)�ڔ�(sh��)��(j��)�[˽����Ȼ�ı��o(h��)����, ����������Ȼ���ڴ����[˽й¶���L(f��ng)�U(xi��n).

����• ����, (li��n)��W(xu��)��(x��)��Ҫ���Q���g����(sh��)�f(xi��)ͬӖ(x��n)��, ����й¶�[˽. �c����ʽ�W(xu��)��(x��)��ͬ, (li��n)��W(xu��)��(x��)Ӗ(x��n)���^����Ҫ���Q�������g����(sh��), �����y��ԭʼ��(sh��)��(j��)��(hu��)��¶�����Ѕ��cӖ(x��n)���Ľ�ɫ��ǰ, ����й¶���L(f��ng)�U(xi��n). ����, �����о�����, ����ͨ�^�ݶ�߀ԭ����ԭʼ��(sh��)��(j��)[3], �����(j��)���g����(sh��)�Ɣ����յ�ӛ䛃�(n��i)���Ƿ����ij��(g��)�ض����c��[4].

����• ���, ���ɿ��ą��c���ӄ����[˽й¶���L(f��ng)�U(xi��n). (li��n)��W(xu��)��(x��)��, ����(g��)���c�����ڵ������O(sh��)��ȗl����ͬ, ͨ�Ń�(n��i)�ݵ���Ч�Ժ����ݵ��挍(sh��)�Զ��y�Դ_�J(r��n), ���һ�����F(xi��n)���ɿ��ą��c������, �O��й¶�[˽. ����, ���\��(sh��)�ą��c���܉����(j��)�Ϸ��@ȡ�����g����(sh��)�Ɣ���������c���Ę�(bi��o)����(sh��)��(j��); ������ą��c�����M(j��n)һ��, �܉�ͨ�^�ς������O(sh��)Ӌ(j��)���к���Ϣ�T��(d��o)�������c����¶�������픵(sh��)��(j��), ���߲������[˽�f(xi��)�h�M(j��n)��Ӱ�ȫ�ֵ��[˽��.

����• ����, Ӗ(x��n)����ɵ�ģ��Ҳ���R���[˽й¶���L(f��ng)�U(xi��n). ����(li��n)��W(xu��)��(x��)���^���Ѕ���(sh��)�]��й¶, ֱ�Ӱl(f��)��Ӗ(x��n)�����õ�ģ����Ȼ���ژO���L(f��ng)�U(xi��n). �@�N�L(f��ng)�U(xi��n)���ԙC(j��)���W(xu��)��(x��)�����Ĵ�����. ��Ӗ(x��n)����, ģ����ߜ�(zh��n)�_����ه�ڌ�(du��)��(sh��)��(j��)�ӱ���Ҏ(gu��)���ھ�. �����о���[4]ע�, ��ģ����Ӗ(x��n)���ӱ��ϵĜ�(zh��n)�_��, ���܌�(d��o)��ģ�͵ą���(sh��)�����Y(ji��)��(g��u)“ӛס”Ӗ(x��n)���ӱ��ļ�(x��)��(ji��), ʹ��ģ�͔y��Ӗ(x��n)������������Ϣ. ����(j��)�@һ����, �����߿���ͨ�^����(f��)��ԃģ�͵��A(y��)�y�ӿځ��Ɯyij�lӛ��Ƿ������Ӗ(x��n)�������Ɯyģ�͵ľ��w����(sh��), ������(j��)ģ�Ͱl(f��)���ą���(sh��)�܉��M(j��n)һ���ƜyӖ(x��n)�����ɆT��Ӗ(x��n)�������w�ӱ�.

�����ɴ˿�Ҋ, ���ӱ��o(h��)���M(j��n)��(li��n)��W(xu��)��(x��), Ӗ(x��n)�����漰�ı������c�ߵĔ�(sh��)��(j��)�������Rй¶���L(f��ng)�U(xi��n). ����(sh��)��(j��)һ��й¶, ���H�[˽й¶�����R��(y��n)��?f��)pʧ, ���c���g�˴����κ�����(li��n)��Ӗ(x��n)��ģʽҲ���y�Ԟ��^. ��Q(li��n)��W(xu��)��(x��)��Ϣй¶���}����ü��. Ȼ��, (li��n)��W(xu��)��(x��)�Д�(sh��)��(j��)�ֲ���(f��)�s����(y��ng)�È����S������Ҫ��Δ�(sh��)��(j��)���Q, �@Щ���؞��[˽���o(h��)����һϵ������(zh��n).

����• ��һ, (li��n)��W(xu��)��(x��)��Ӗ(x��n)�����������������(f��)�s, �F(xi��n)�е��[˽���o(h��)�����o��ͨ��. ���еļ���ʽ�C(j��)���W(xu��)��(x��)�[˽���o(h��)�о������ķ���(w��)���\��(sh��)��ǰ��, �H���]ģ�Ͱl(f��)��������ܵ��Ĺ���, �]��ᘌ�(du��)��(n��i)�������ߵĽ�Q����. ���ҬF(xi��n)���㷨���ᘌ�(du��)��һ�ļ���ʽӖ(x��n)������, �]�п��]����(g��)���c������N�ܘ�(g��u)����N��(sh��)��(j��)�ֲ���ʽ�µĔ�(sh��)��(j��)���Q��ģ�ͅf(xi��)ͬӖ(x��n)������r. ���, �O(sh��)Ӌ(j��)�m��(y��ng)��ͬ�����Ͳ�ͬ������[˽���o(h��)�㷨, ͬ�r(sh��)�����ⲿ�̓�(n��i)������, ��(li��n)��W(xu��)��(x��)�[˽���o(h��)����Ҫ����(zh��n).

����• �ڶ�, (li��n)��W(xu��)��(x��)�Ѕ��c���Ŀ��ų̶ȵ�, ���ڵĹ����Ƕȶ�, ��(du��)�[˽���o(h��)�㷨��������Ҫ�����. �@��, ������ָģ�����̐������(w��n)���\(y��n)�е�����. (li��n)��W(xu��)��(x��)��, ���c��һ���l(f��)��, �܉��^�쵽��������g����(sh��), �����܉�۸ą���(sh��)Ӱ�Ӗ(x��n)���^��, �[˽�������y���h(yu��n)�����ⲿ���F(xi��n)�Ĺ���. �����c��֮�g������\, ���ܫ@ȡ����������Ϣ. ���, ����[˽���o(h��)�㷨��������, �p���[˽�㷨�Ќ�(du��)���c�ߵĿ��ų̶ȵļ��O(sh��), ��(li��n)��W(xu��)��(x��)�[˽���o(h��)���R���y�}.

����• ����, (li��n)��W(xu��)��(x��)����ͨ�Ų���(w��n)��, ģ��Ӌ(j��)����r(ji��)��, �����(du��)�[˽���o(h��)�C(j��)�Ƶ�ͨ�����͏�(f��)�s��Ҫ���(y��n)��. �F(xi��n)��(sh��)�����µ�(li��n)��W(xu��)��(x��)�����R�ď�(f��)�s��ɢ�ľW(w��ng)�j(lu��)�Y(ji��)��(g��u)��(d��o)�½K��ͨ�Ų���(w��n)��, �ڴ˻��A(ch��)�ϵ��[˽���o(h��)�㷨�y�Ժ���. ����(f��)�s���[˽���o(h��)�㷨���������ߵ�Ӌ(j��)����������ͨ�Ŵ��r(ji��), �M(j��n)һ���Ƽs(li��n)��W(xu��)��(x��)��Ӗ(x��n)��Ч��. �о���Ч�ʡ��p����(j��)��(li��n)��W(xu��)��(x��)�[˽���o(h��)�㷨, �����~���_�N, ��(li��n)��W(xu��)��(x��)�[˽���o(h��)����挦(du��)������(zh��n).

����• ����, (li��n)��W(xu��)��(x��)�Ѕ���(sh��)�S�ȸߡ���(sh��)��(j��)�ֲ�����, �y�����ṩ�[˽���o(h��)��ͬ�r(sh��)����ģ�͵Ŀ�����. (li��n)��W(xu��)��(x��)���g����(sh��)�ľS���cģ�ͽY(ji��)��(g��u)��ݔ�딵(sh��)��(j��)�S�����P(gu��n), ����(sh��)�S�������O��, ����˘O����[˽�_�N. ����, (li��n)��W(xu��)��(x��)���Ñ���(sh��)�������Ҕ�(sh��)��(j��)����С��һ, �����ƽ�ⲻͬ��(sh��)��(j��)����ͬ�r(sh��)���o(h��)�[˽, Ҳ��һ��(g��)������(zh��n).

�����C������, ���Ӿ���(x��)���[˽�����O(sh��)Ӌ(j��)�����Ӿ��_���[˽�A(y��)����䡢�����m��(y��ng)��(sh��)��(j��)���Q���[˽�f(xi��)�h��(g��u)��, ��(li��n)��W(xu��)��(x��)�[˽���o(h��)�M(j��n)һ���l(f��)չ����挦(du��)���h�}. �����_�F(xi��n)�е��[˽���}�ͱ��o(h��)�ֶ�, �Ǽ��g(sh��)�l(f��)չ�Ļ��A(ch��). (li��n)��W(xu��)��(x��)�Ļ��A(ch��)——�C(j��)���W(xu��)��(x��)���[˽�����ͷ����ѽ�(j��ng)������{(di��o)��[5]. �C(j��)���W(xu��)��(x��)���R���ⲿ����ͬ�����{��(li��n)��W(xu��)��(x��)�İl(f��)��ģ��, ���ǙC(j��)���W(xu��)��(x��)���[˽���o(h��)�ֶ΅s�h(yu��n)�h(yu��n)�����Ԟ�(li��n)��W(xu��)��(x��)�ṩ���o(h��). �@������(li��n)��W(xu��)��(x��)ͬ�r(sh��)���R�����y(t��ng)���ⲿ�������䪚(d��)�еă�(n��i)������, ���(li��n)��W(xu��)��(x��)���[˽���o(h��)�������ͬ�r(sh��)���(n��i)��Ӗ(x��n)���^�̺��ⲿģ�Ͱl(f��)���ṩ�p�ر��o(h��).

��������, ���ЌW(xu��)���{(di��o)����(li��n)��W(xu��)��(x��)�[˽���o(h��)�ĬF(xi��n)��, ������˼·�c���IJ�ͬ, ��(c��)�صķ������īI(xi��n)Ҳ����ͬ. Lyv ����[6]�� Wang ����[7]��(du��)(li��n)��W(xu��)��(x��)�����ܵ��Ĺ�������Ԕ��(x��)���U��, �����ڰ�ȫ�������[˽�����ą^(q��)���ϛ]���M(j��n)һ���{(di��o)��. �������_�ɷN�����ĸ����: �Ը`ȡ��(sh��)��(j��)���Ɖ�ģ���[˽�Ժ͙C(j��)���Ԟ�Ŀ�ĵĹ������[˽����, �Ըɔ_ģ��Ӗ(x��n)���Y(ji��)�����Ɖ�ģ�Ϳ����Ժ������ԵĹ����鰲ȫ����. ����, ����߀����(j��)�F(xi��n)�е��[˽�������g(sh��)��ԭ��w�{����Ҫ���Է��. �F(xi��n)���īI(xi��n)[7−10]���ļ��g(sh��)��Ӗ(x��n)���A�εĽǶȷ�����Ŀǰ��(li��n)��W(xu��)��(x��)�[˽���o(h��)�㷨, �����ĸ���(j��)(li��n)��W(xu��)��(x��)�������Է��������е��[˽й¶��(n��i)�ݺ�й¶λ��, ���[˽���o(h��)�Č�(du��)��ĽǶȳ��l(f��)��������, ���w�{ÿ��(g��)e����Ҫ�ı��o(h��)�C(j��)��, �M(j��n)���������ò�ͬ���g(sh��)���㷨�Ĺ��Բ�̽���C(j��)�Ʊ����ă�(y��u)�ݺͲ���. �M(j��n)һ����, ���Ľ����˹��������c���o(h��)�C(j��)��֮�g��(li��n)ϵ, ���ڴ˻��A(ch��)�χLԇ��(li��n)��W(xu��)��(x��)�[˽���o(h��)�İl(f��)չ������h.

�������ĵ� 1 ��(ji��)��B(li��n)��W(xu��)��(x��)�ļܘ�(g��u)�����, �Լ�����(y��ng)�����µ�Ӗ(x��n)����ʽ. �� 2 ��(ji��)����(li��n)��W(xu��)��(x��)�挦(du��)���[˽й¶�L(f��ng)�U(xi��n)��Դ, ���Y(ji��)���w�Ĺ�������. �� 3 ��(ji��)��B��N�[˽���o(h��)���g(sh��)ԭ��, ������w�{����Ϣģ�����^�̼��܃ɷN�[˽���o(h��)�C(j��)��. �� 4 ��(ji��)�{(di��o)���[˽���o(h��)���g(sh��)��(li��n)��W(xu��)��(x��)�еđ�(y��ng)��, ���w���ر��o(h��)�����ı��o(h��)�������c���ؽY(ji��)���@ 3 �N���o(h��)����, ����(du��)ÿ�N����չ�_����Ԕ��(x��)���U��. �� 5 ��(ji��)ӑՓ�F(xi��n)�в��㲢չ��δ������.

����1.1 (li��n)��W(xu��)��(x��)�ܘ�(g��u)

������Ҋ��(li��n)��W(xu��)��(x��)�ܘ�(g��u)��͑�-����(w��)��. ���͵Ŀ͑�-����(w��)���ܘ�(g��u)��һ��(g��)���ķ���(w��)���Ͷ���(g��)���Д�(sh��)��(j��)�Ŀ͑��˽M��. ���V�����õ�(li��n)��ƽ�� FedAvg[1]���ǻ��ڿ͑�-����(w��)���ܘ�(g��u)�O(sh��)Ӌ(j��)���㷨. ��Ӗ(x��n)����, ���ķ���(w��)�����S�C(j��)��ʼ����ģ�ͽY(ji��)��(g��u)�ͅ���(sh��)�ְl(f��)�o�͑���, �͑��˸���(j��)����?c��i)?sh��)��(j��)Ӗ(x��n)��������ģ�ͺ���(sh��)�ς�. ���ķ���(w��)���յ���������(sh��)��ۺ�Ӌ(j��)��, ����ģ�ͅ���(sh��)�ٴ��°l(f��). ԓ�^��ѭ�h(hu��n), ֱ��ģ���Ք���Ӗ(x��n)���Kֹ. ���˳�Ҋ��ģ�ͅ���(sh��)���Q����, Ҳ�����ݶȽ��Q����(sh��)��(j��)������Ƕ��ʽ��ʾ���Q�ȷ�ʽ. �ڴ˼ܘ�(g��u)��, ԭʼ��(sh��)��(j��)����Ҫ��ݔ, ���DZ������g����(sh��)��¶�o�����ķ���(w��)��, ȫ�����g����(sh��)�t��(hu��)��ÿ��(g��)�͑��˫@ȡ, ��(sh��)��(j��)���Q�^����, ���ͨ����Ҳ��(hu��)Ӱ�Ӗ(x��n)��Ч��. ����(d��ng)���cӖ(x��n)���Ŀ͑��˔�(sh��)���^���r(sh��), ���ķ���(w��)���ľۺ�Ӌ(j��)���������ܳɞ�ȫ��Ӗ(x��n)��Ч�ʵ�ƿ�i.

������(d��ng)�]�����ķ���(w��)���r(sh��), (li��n)��W(xu��)��(x��)������һ�N��Ҋ�ܘ�(g��u): �ˌ�(du��)�˵ľW(w��ng)�j(lu��)�ܘ�(g��u)[12]. �@�N�ܘ�(g��u)�H�ɳ��Д�(sh��)��(j��)�ĽK�˽M��. ���cӖ(x��n)���ĽK�� Fi ֱ�ӌ�Ӗ(x��n)������(sh��)�l(f��)�ͽo��һ��(g��)(�����(g��))�K�� Fi+1, ��һ��(g��)(�����(g��))�K�� Fi+1 ���ռ�����һ��(g��)(�����(g��))����(sh��)���A(ch��)���^�m(x��)Ӗ(x��n)��, ֱ��ģ���Ք�����Ӗ(x��n)���Kֹ. �ˌ�(du��)�˾W(w��ng)�j(lu��)�ܘ�(g��u)����ه���ķ���(w��)���@�ӵĵ������C(j��)��(g��u), �������g����(sh��)ֱ���څ��c��֮�g����. �����Ҫ���]���c����΅f(xi��)��ʹ����ͬ��ģ�͡��㷨����ʼ������(sh��)�Ȼ�����Ϣ, �f(xi��)�{(di��o)�������cӖ(x��n)�������.

�������������и���y(t��ng)һ����������, ���Č��͑�-����(w��)���еķ���(w��)���Q�����ķ���(w��)��; ���͑�-����(w��)���еĿ͑��˺Ͷˌ�(du��)�˼ܘ�(g��u)�еą��cӖ(x��n)���K�˽y(t��ng)�Q��K��; ���Ѕ��cӖ(x��n)���ķ���(w��)�����K�˽y(t��ng)�Q�酢�c��. Ӗ(x��n)���^���аl(f��)�͵��ݶȡ�ģ�ͅ���(sh��)��Ƕ��ʽ��ʾ��, �y(t��ng)�Q�����g����(sh��). �����ɷN���ͼܘ�(g��u)��D 1 ��ʾ.

����1.2 (li��n)��W(xu��)��(x��)���

��������(j��)���c���Ęӱ��ֲ���r, (li��n)��W(xu��)��(x��)���Ք�(sh��)��(j��)�Ą�����r���Է֞� 3 �N���: �M��(li��n)��W(xu��)��(x��)���v��(li��n)��W(xu��)��(x��)���w��(li��n)��W(xu��)��(x��). ��ͬ�Ĕ�(sh��)��(j��)�Ą��ַ�ʽ��Ҫ��Ӗ(x��n)����ʽ�����g����(sh��)��ͬ, Ҳ���[˽й¶���L(f��ng)�U(xi��n)�ͱ��o(h��)��ʽ����Ӱ�. �M��(li��n)��W(xu��)��(x��)��, ����(g��)���c�����еĔ�(sh��)��(j��)������ͬ, �����յĘӱ���ͬ. ����, �ׂ�(g��)��ͬ���е��t(y��)Ժ������������ͬ���˵���r, �������ھ߂����Ƶ��t(y��)���ֶ�, �t(y��)Ժ�@ȡ���ԵČ�����ͬ. �M��(li��n)��W(xu��)��(x��)�е��͵ķ�ʽ֮һ�ǵ� 1.1 ��(ji��)��������(li��n)��ƽ���㷨 FedAvg, �����ݶ�ƽ����ģ��ƽ���ɷN���[13], ���ɿ͑�-����(w��)���ܘ�(g��u)��(sh��)�F(xi��n). �ݶ�ƽ����ָ�K�˽��Q�;ۺ�ģ���ݶ�, ��ģ��ƽ��ָ�ۺ�ģ�ͅ���(sh��). �ڶˌ�(du��)�˼ܘ�(g��u)��, ����(g��)���c��Ӗ(x��n)������ģ��, ͨ�^ѭ�h(hu��n)�l(f��)�ͽo��һ��(g��)(�����(g��))Ӗ(x��n)���������S�C(j��)��ݔij��(g��)(�����(g��))�K��[14]��(sh��)�F(xi��n)ģ�ͅ���(sh��)�Ĺ���.

�������v��(li��n)��W(xu��)��(x��)�tᘌ�(du��)�෴������, ������(g��)���c�����еĔ�(sh��)��(j��)������ͬ, �����յĘӱ���ͬ. ����, ͬһ��(g��)�����е��t(y��)Ժ���y�ж��Ӵ��^ͬһ��(g��)����, ������ԓ����ľ��\ӛ䛻��Y���r. �@Ȼ, �t(y��)Ժ���y�Ы@ȡ�Ĕ�(sh��)��(j��)������ȫ��ͬ, ���������еĘӱ� ID ���دB��. �v��(li��n)��W(xu��)��(x��)������Ҫ���c����(du��)�R��ͬ ID �Ęӱ�, Ȼ��, ����(g��)���c���ڌ�(du��)�R�Ęӱ��ϷքeӖ(x��n)������ģ�Ͳ����텢��(sh��). ��ͬ�ܘ�(g��u)ͬ�Ӷ��m���ڿv��(li��n)��W(xu��)��(x��), �����ڔ�(sh��)��(j��)�Ŀv��ֲ�, ���c��֮�g����ه�̶ȸ���, ģ����Ҫ���Ӿ���(x��)���O(sh��)Ӌ(j��). �v��(li��n)��W(xu��)��(x��)�ё�(y��ng)���ھ��Իؚw[11]��������[15]���ݶ��½�[16]�ȶ�Nģ����. �Կv��(li��n)��W(xu��)��(x��)���Իؚw�㷨[11]����, ԓ�㷨�ژӱ���(du��)�R��, ���pʧ����(sh��)���ݶȲ��, ʹ�Ãɂ�(g��)���c���܉�ʹ�ø��Եı���?c��i)?sh��)��(j��)�քeӋ(j��)���ݶȵ�һ����, ����Ҫ��ͬӋ(j��)��IJ��քtͨ�^�p�����Q����(sh��)�f(xi��)ͬ���. �v��ֲ��Ĕ�(sh��)��(j��)֮�g�o�ܵ����P(gu��n)��, ��v��?q��)W��(x��)��Ч�ʺ����e(cu��)�Ԏ�������(zh��n).

���������ɷN��Ͷ��DZ��^�������r, �F(xi��n)��(sh��)������, �օ��c�������еĔ�(sh��)��(j��), �������͘ӱ� ID �ϵ��دB�����^���Ҕ�(sh��)��(j��)���ֲ���ƽ��. ᘌ�(du��)�@�ӵ�����, �w�ƌW(xu��)��(x��)����(y��ng)�õ�(li��n)��W(xu��)��(x��)�Ё�. �w�ƌW(xu��)��(x��)����һ�N��Ч�ČW(xu��)��(x��)˼��, �܉�?q��)����P(gu��n)�I(l��ng)���е�֪�R(sh��)�w�Ƶ�Ŀ��(bi��o)�I(l��ng)����, ʹ�ø���(g��)���c����ͬ�W(xu��)��(x��)�õ��w��֪�R(sh��). �ԃɷ��w�ƌW(xu��)��(x��)����[17], ���O(sh��)һ�� A ���ӱ��IJ���������ȫ����(bi��o)��, ��һ�� B ���ղ�������, �p�������͘ӱ� ID ֮�g���������دB. (li��n)���w�ƌW(xu��)��(x��)���Ȍ�(du��)�R�ӱ�����ͬӖ(x��n)��ģ��, Ȼ���A(y��)�y B ���ӱ��Ę�(bi��o)��. �����_(d��)���A(y��)��Ч��, Ӗ(x��n)����Ŀ��(bi��o)����(sh��)�����ɂ�(g��)����: һ�����Ǹ���(j��)���еĘ�(bi��o)���A(y��)�y B ���ӱ�, ʹ�A(y��)�y�`����С��; ��һ������ A �c B ��(du��)�R�Ęӱ�֮�g��Ƕ��ʽ��ʾ�ą^(q��)�e��С��. ��������(j��)Ŀ��(bi��o)����(sh��)�ڱ���Ӗ(x��n)��, �����Q���g����(sh��)����ģ��, ֱ��ģ���Ք�.

����Ŀǰ, �v����w��(li��n)��W(xu��)��(x��)���[˽���o(h��)�㷨�о�߀������, �ұ��o(h��)��ʽ�c�M��(li��n)��W(xu��)��(x��)�������. ���˱�������, �������{(di��o)�е��[˽���o(h��)�㷨���o�e�f��, ����M��(li��n)��W(xu��)��(x��)����.

����2 (li��n)��W(xu��)��(x��)�е��[˽й¶�L(f��ng)�U(xi��n)

�����M��(li��n)��W(xu��)��(x��)��ֱ�ӽ��Q��(sh��)��(j��), �Ȃ��y(t��ng)�ļ���ʽ�C(j��)���W(xu��)��(x��)Ӗ(x��n)�����˸��ߵ��[˽����, ��(li��n)��W(xu��)��(x��)�������]���ṩȫ���ֵ��[˽���o(h��), ��Ȼ���R����Ϣй¶�����{. ģ�����R���[˽й¶�L(f��ng)�U(xi��n)����ģ��Ӗ(x��n)�������Ĵ����Ժ����ߵď�(qi��ng)������: ģ��Ӗ(x��n)���^����, ��(d��)�ؼܘ�(g��u)��Ӗ(x��n)���A�ΛQ�����[˽й¶��λ�ú͕r(sh��)�C(j��); �����ߵĽ�ɫ������, �Q�����[˽й¶�ă�(n��i)�ݺͳ̶�. ������������(j��)������������ȡ�Ĺ�������, �t�M(j��n)һ��Ӱ푹����ߵ�����, �Ķ�Ӱ�ģ���[˽й¶���L(f��ng)�U(xi��n). �����[˽й¶���L(f��ng)�U(xi��n), ���ܞ�(li��n)��W(xu��)��(x��)�[˽�����ҵ����w����.

����2.1 �[˽й¶�L(f��ng)�U(xi��n)��Դ

���������������и��õ������[˽����, �҂����Ƚ���(li��n)��W(xu��)��(x��)����ģ��. • ����(j��)��ɫ, �����߷֞��(n��i)�����ⲿ: ��(n��i)�������߰�������Ӗ(x��n)�������g����(sh��)���҅��cӖ(x��n)���^�̵ĽK�˺����ķ���(w��)��; ���ⲿ�����߰�������ģ�Ͱl(f��)���ą���(sh��)����ԃ�ӿڵ��]�Ѕ��cӖ(x��n)���^�̵�ģ��ʹ����. �c�ⲿ���������, ��(n��i)������������ģ�͵ĸ�����Ϣ, ������������(qi��ng).

����• ����(j��)���ų̶�, �����߷֞���\��(sh��)��ɫ�͐����ɫ: ���\��(sh��)��ɫָ���c����(y��n)������Ӗ(x��n)���f(xi��)�h������, �H����(j��)�Ϸ��@ȡ����Ϣ�����Ɣ�, ��(du��)��Ӗ(x��n)���Y(ji��)���]��Ӱ�; �����ɫָ���c�������f(xi��)�h, �څ��c�^���А���۸Ĕ�(sh��)��(j��)��ע��ģ�K, �T��(d��o)Ŀ��(bi��o)й¶�[˽��Ӱ�Ӗ(x��n)���Y(ji��)��.

����• ����(j��)����ģʽ, �����֞鱻��(d��ng)������(d��ng): ����(d��ng)����ָ�����߃H�^����L��ģ�ͫ@ȡ��Ϣ; ����(d��ng)����ָ�����ߴ۸Ĕ�(sh��)��(j��)��ģ��, ���c��Ӱ�Ӗ(x��n)���^��. ��Ҫ�f������, ����ģʽ�c���ų̶Ȳ�����ȫ��(du��)��(y��ng). �����ٔ�(sh��)����(d��ng)�������܉������ς�����(sh��)�T��(d��o)Ŀ��(bi��o)й¶�[˽��ͬ�r(sh��)��Ӱ�(li��n)��Ӗ(x��n)��Ŀ��(bi��o), �\��(sh��)���_�����Ӗ(x��n)���΄�(w��).

����• ����(j��)������֪�R(sh��), �����֞�й����ͺںй���: �й���ָ����������ģ�͵����P(gu��n)��Ϣ, ������(sh��)��(j��)�ķֲ��ͽy(t��ng)Ӌ(j��)��Ϣ��ģ��Ӗ(x��n)����ɵĽY(ji��)��(g��u)����(sh��)��ģ��Ӗ(x��n)���^���е����g����(sh��); �ںй���ָ�����ߌ�(du��)���P(gu��n)��Ϣһ�o��֪, �H��Ո(q��ng)���ԃ�ę�(qu��n)��.

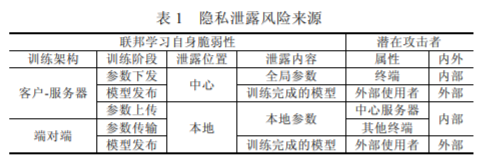

����(li��n)��W(xu��)��(x��)��������(sh��)�ς����°l(f��)������(sh��)��ݔ��ģ�Ͱl(f��)���ȶ���(g��)�A��, ����, ����(sh��)�ς����°l(f��)��͑�-����(w��)���ܘ�(g��u)�����е��A��, ����(sh��)��ݔ��ˌ�(du��)�˼ܘ�(g��u)�����е��A��, ģ�Ͱl(f��)����ɷN�ܘ�(g��u)���е��A��. ÿ��(g��)�A���[˽й¶��λ�ú̓�(n��i)�ݲ�ͬ, ���{�[˽�Ĺ����߽�ɫҲ����ͬ. �о�(li��n)��W(xu��)��(x��)��ͬ�A���[˽й¶�L(f��ng)�U(xi��n), �����ڞ��[˽���o(h��)�ṩ������˼·�ͷ���. �[˽й¶�L(f��ng)�U(xi��n)��Դ�Č�(du��)��Ҋ�� 1.

�����ڿ͑�-����(w��)���ܘ�(g��u)��, Ӗ(x��n)���֞� 3 ��(g��)�A��.

����• �� 1 �A��, ����(�K��)Ӗ(x��n)����, �ς�������(sh��)�o���ķ���(w��)��. ���A�εĝ��ڹ����߶������ķ���(w��)��. ���ķ���(w��)������(j��)�ռ��ı�����(sh��)�܉�l(f��)���ؽ�����, �֏�(f��)Ŀ��(bi��o)�K�˵�ԭʼ��(sh��)��(j��); ���߰l(f��)�������Ɣ��, �Ɣ�Ŀ��(bi��o)�K�˵Ĕ�(sh��)��(j��)���Ƿ���ijЩ���Ќ���.

����• �� 2 �A��, ���ķ���(w��)���ۺϸ���(g��)�K�˵ą���(sh��)̎����, �ٴ��°l(f��)ȫ�օ���(sh��). �˕r(sh��)�ĝ��ڹ������Dz����ŵĽK��. �K���܉����(j��)ȫ�����g����(sh��)�l(f��)���ؽ�ij��(g��)e�ӱ�(generic sample), ���Ɣ�ij�lӛ䛵����Ќ����Ƿ����, �M(j��n)������(j��)Ӗ(x��n)�����Ĺ�ͬ�����Ɣ�����ԓӛ䛵Ă�(g��)�w����r, ����Ӗ(x��n)�����ǰ��̲�������(sh��)��(j��), ���ԓ��(g��)�w����ԓӖ(x��n)����, �tһ��Ҳ���а��̲�.

����• �� 3 �A��, ģ��Ӗ(x��n)�����, �����ķ���(w��)���l(f��)��ģ��. һ��İl(f��)����ʽ����ֱ�ӌ�ģ�Ͳ������Ñ���, ���ṩ API �L���ӿڃɷN. �˕r(sh��)�ĝ��ڹ��������ⲿʹ����. �����ŵ��ⲿʹ�����܉����(j��)ģ�͵ą���(sh��)��ģ�͵��A(y��)�y�Y(ji��)���l(f��)���Ɣ�����ؽ�������(sh��)��ȡ����[18−22]. ͨ�^�l(f��)����ģ���Ɯy���cӖ(x��n)���Ĕ�(sh��)��(j��)���ӱ�, �����(j��) API �L���ӿ��Ɯyģ�ͅ���(sh��), �M(j��n)������Ӗ(x��n)����(sh��)��(j��). �ڶˌ�(du��)�˼ܘ�(g��u)��, Ӗ(x��n)���֞�ɂ�(g��)�A��:

����• �� 1 �A��, ����(�K��)Ӗ(x��n)����, ��������(sh��)��ݔ�o��һ�K��. �����ߞ鲻���ŵĽ��սK��. �K�˽��ձ�����(sh��)��, ͬ���܉�l(f��)���ؽ�������?q��)����Ɣ�? ��ʹ���ص�ԭʼ��(sh��)��(j��)й¶.

����• �� 2 �A��, ģ��Ӗ(x��n)����ɺ�, �K�����l(f��)��ģ��, �t���R�c�͑�-����(w��)���ܘ�(g��u)ͬ�ӵ��ⲿ����; ��H����(n��i)��ʹ��, �t�o횿��].

������Ҫ�f������, (li��n)��W(xu��)��(x��)���[˽������Ҫ�Ƀ�(n��i)�����c���l(f��)��. �c�ⲿ���������, ��(n��i)�������߾߂����(qi��ng)������, ���H������Ӗ(x��n)���^����ͨ�^ֱ�ӫ@ȡ��(sh��)��(j��)���Q�е�����Ƕ��ʽ��ʾ���ݶȺ�ģ�ͅ���(sh��)�Ȱl(f��)��, ߀�܉�ͨ�^��Q�ӱ��������ݶ������ēpʧ����(sh��)�ȷ�ʽӰ�ģ�͵�Ӗ(x��n)���^��, �T��(d��o)Ŀ��(bi��o)�K�˱�¶�����[˽��Ϣ, ����Ɣ�����ؽ�����. (li��n)��W(xu��)��(x��)���˅f(xi��)ͬӖ(x��n)������ģ����Ҫ�������c��, �sȱ���c֮��(du��)��(y��ng)�����ݴ_�J(r��n)�C(j��)�ƺ��\�ű���, �y�Է���“��(n��i)��”й¶. ���y(t��ng)�ļ���ʽ�C(j��)���W(xu��)��(x��)�[˽���o(h��)�܉�����ⲿ����, �s�]�е�����(n��i)������������. ��������(li��n)��W(xu��)��(x��)�挦(du��)���L(f��ng)�U(xi��n), �������Ƚ�B�ⲿ����������A(ch��), ���c(di��n)ᘌ�(du��)�����еă�(n��i)���[˽����չ�_����.

����2.2 �[˽��������

��������(j��)�������[˽й¶�L(f��ng)�U(xi��n)�����ߵ�����, �о����O(sh��)Ӌ(j��)�˲�ͬ��(li��n)��W(xu��)��(x��)�ܘ�(g��u)���A���¿��ܵ��[˽����, ��ͨ�^��(sh��)�(y��n)չ�F(xi��n)���@Щ����(du��)���Д�(sh��)��(j��)�ľ����{. �[˽�����߰������cģ��Ӗ(x��n)���ă�(n��i)����ɫ��δ���cģ��Ӗ(x��n)���H�ܽ��|�l(f��)��ģ�͵��ⲿ��ɫ. �����߲�ȡ����Ҫ�������ؽ��������Ɣ��: �ؽ�������, �����߸���(j��)���յ����g����(sh��)�Լ�ģ����Ϣ�֏�(f��)����Ӗ(x��n)����(sh��)��(j��); �Ɣ����, �����߸���(j��)���g����(sh��)�Ͱl(f��)������(sh��)�Ɣ�Ӗ(x��n)�������Ƿ����ض���ӛ�. ��(n��i)���Լ��ⲿ�����߲����������Ԍ�(du��)(li��n)��W(xu��)��(x��)�l(f��)���[˽����, �@ȡӖ(x��n)������������Ϣ. ����, ��(n��i)���[˽���������Ŀ��Y(ji��)��Ҋ�� 2.

����2.2.1 �ؽ�����

�����ؽ�����(reconstruction attack)ָ�����߸���(j��)Ӗ(x��n)�����g����(sh��)��ģ�͵ą���(sh��)����Ո(q��ng)���ԃ����ݔ��, �֏�(f��)���cӖ(x��n)���Ĕ�(sh��)��(j��)���е���Ϣ. ����(j��)�����߽�ɫ, �ؽ������֞��ⲿ�̓�(n��i)������: �ⲿ�ؽ���������ģ��Ӗ(x��n)����ɲ��l(f��)����, �ⲿʹ���߰l(f��)��Ĺ���; ��(n��i)���ؽ�����t����ģ��Ӗ(x��n)���A��, ��(n��i)�����c���l(f��)��Ĺ���.

�������P(gu��n)֪�R(sh��)���]��Փ�Č�������ô����(zh��n)���]

�����ⲿ�ؽ�������, �����߃H������ģ�͵IJ�ԃ�Y(ji��)����ģ�Ͱl(f��)���ĽY(ji��)��(g��u)�ͅ���(sh��), ���ֻ�ܲ���ԇ̽ģ�͵�ݔ���Y(ji��)��, ͨ�^�{(di��o)��ݔ�딵(sh��)��(j��)ʹݔ��ֵ���A(y��)�ڷ��n. Fredrikson ����[20]�״��O(sh��)Ӌ(j��)���ⲿ�������ںں���r�°l(f��)���ģ�͵��ƹ���, ԓ�㷨����ģ�͵�ݔ����һЩ�����Ќ��Ի֏�(f��)�˲��˵Ļ�����Ϣ. �������O(sh��)�ӱ����� d �S����, ����, f1�� fd−1�����������, �ڽo��������������ģ��ݔ���r(sh��), ����������� fd�ĺ��(y��n)����. ���������H���Ɣ����Ќ���, Fredrikson ����[21]���S��Ĺ������O(sh��)Ӌ(j��)�˰���r�µ�ģ�͵��ƹ���. �ⲿ�����߸���(j��)Ӗ(x��n)����ɵ�ģ�ͅ���(sh��)Ӗ(x��n)����ȌW(xu��)��(x��)ģ��, �֏�(f��)Ӗ(x��n)�����е�ȫ������. ԓ����ͨ�^���־W(w��ng)�j(lu��)�Y(ji��)��(g��u)�ͅ���(sh��)��׃, ��(du��)ݔ����S�C(j��)����ֵ���S�C(j��)��(bi��o)���ݶ��½�. ��(d��ng)ģ���A(y��)�y���Ŷ��_(d��)���(y��u)�r(sh��), ���ɵĈDƬ�����cӖ(x��n)������(sh��)��(j��)�߶Ƚ���. Luo ����[32]�״�����˿v��(li��n)��W(xu��)��(x��)�е������ؽ�����. ����(bi��o)��������(d��ng)���c���ګ@ȡ��Kģ�͵��A(y��)�y�Y(ji��)����, �܉����(j��)��ʽ���ƻ�ͨ�^·�������ؽ�������(bi��o)���ı���(d��ng)���c���Ĕ�(sh��)��(j��)����. �����㷨�Ĺ����߽�ɫ�����ⲿ������, �H������ģ�͵ò�ԃ�Y(ji��)����ģ�Ͱl(f��)���ĽY(ji��)��(g��u)�ͅ���(sh��), ���ֻ�ܲ���ݔ�딵(sh��)��(j��)ԇ̽ģ�͵�ݔ���Y(ji��)��.

�����ⲿ������ģ��ݔ���Լ��l(f��)������K����(sh��)������(j��), �ؽ�����(g��)��(sh��)��(j��)���ķ����ӱ�(generic sample), �y�ԫ@ȡԔ��(x��)��������Ϣ. ����, ������Ч�ķ���������ݔ�����ȵ��ֶ�, �����ںܴ�̶��ϵ����@���. ���֮��, (li��n)��W(xu��)��(x��)�ă�(n��i)���ؽ��������и����S����֪�R(sh��)����, �܉������g����(sh��)������(j��)�l(f��)��. ���g����(sh��)���H�c�Ñ���(sh��)��(j��)�o�����P(gu��n), �����ڵ����ж�α�¶. ��(n��i)���������܉��(j��)���ؽ��ض��Ñ��ľ��w������Ϣ. ������(d��ng)��������r��, ߀�܉�ͨ�^�����g����(sh��)���ς��к���Ϣ��Ӱ�ģ�͵�Ӗ(x��n)���^��, �����T��(d��o)�[˽й¶. ���w�ă�(n��i)���ؽ����������ɷN���: e�ؽ��͘ӱ��ؽ�.

������(n��i)��e�ؽ����ؽ������еij�Ҋ���, ԓ����ͨ�^�ؽ�ij��(g��)e��ͨ�Øӱ�ģʽ�@ȡĿ��(bi��o)e(target class)�е�������Ϣ. ����, ��Ӗ(x��n)���DƬ�R(sh��)�e������r(sh��), Ӗ(x��n)������һ��(g��)e�а����ĈDƬ���w��һ�µ�, �te�ؽ��܉�֏�(f��)Ŀ��(bi��o)e�����w�Ĺ�����Ϣ. Hitaj ����[23]ᘌ�(du��)�͑�-����(w��)���ܘ�(g��u)��(li��n)��W(xu��)��(x��), ����˻������Ɍ�(du��)���W(w��ng)�j(lu��)(generative adversarial networks, GAN)������(d��ng)�ؽ�����. ���������酢�cӖ(x��n)���ĽK��, �ς��۸ą���(sh��)�o����(w��)���T��(d��o)�����\��(sh��)�K�˱�¶��Ϣ, �Ķ��Ɯy�H��Ŀ��(bi��o)�K�����յ�e�Ęӱ�. ���w���f, ���O(sh��)Ŀ��(bi��o)�K�˓���e[a,b]�Ęӱ�, �����ߓ���e[b,c]�Ęӱ�. ��@ȡĿ��(bi��o)e a ����Ϣ, �����������ڱ���Ӗ(x��n)�����Ɍ�(du��)���W(w��ng)�j(lu��), ���Ï����ķ���(w��)���@ȡ��ȫ���ݶȸ������Єe��������Ŀ��(bi��o)e a �Ľ��Ƙӱ�, Ȼ���Ƙӱ������(bi��o)ע��e c Ӗ(x��n)�����ط����, ���ς�����(sh��)�����ķ���(w��)��. �ڵ����^����, ���ڹ����߹��⌢�挍(sh��)��(bi��o)���� a �Ęӱ���� c ��, Ŀ��(bi��o)�K����Ҫ��¶�����c a ���P(gu��n)��Ϣ��“�m��”ȫ���ݶ�, �@Щ��Ϣʹ�ù����ߵ����Ɍ�(du��)���W(w��ng)�j(lu��)�@�ø��Ӝ�(zh��n)�_�ą���(sh��), �֏�(f��)�Ęӱ���Ϣ�� Fredrikson ����[20]����ģ��ݔ���Ĺ����Y(ji��)�������S��������. �����@�N�㷨Ҫ��������(d��ng)�۸�ģ�ͅ���(sh��)��Ӱ�ȫ��ģ�͵�Ӗ(x��n)���Y(ji��)��, ��(du��)�ڹ����ߵ��������O(sh��)�^��(qi��ng). ���۸ĺ�ą���(sh��)Ӱ���Ҳ��(hu��)�ھۺ�ƽ���r(sh��)��ϡ�, ��(d��o)�¹����ߵ��������ܵõ���ȫ�l(f��)�]. Wang ����[24]�S�������һ�N����(d��ng)����ģ�� mGAN-AI, �������܉��ڲ��ɔ_Ӗ(x��n)���^�̵���r���_(d��)���^�õĹ���Ч��. ���w���f, mGANAI ���O(sh��)���\��(sh��)�����ķ���(w��)���܉����(j��)ÿ�ε������@ȡ�ĸ���(g��)�K�˵ľֲ�����(sh��)����Ӗ(x��n)�����΄�(w��)���Ɍ�(du��)���W(w��ng)�j(lu��). ������Ŀ��(bi��o)�K�˵ą���(sh��)���ӱ��Єe��, �ԅ^(q��)��Ŀ��(bi��o)�K�˔�(sh��)��(j��)�Ęӱ�e������Ŀ��(bi��o)�K�˵Ľ��Ɣ�(sh��)��(j��); ���������K�˵ą���(sh��)Ӗ(x��n)�������Єe��, �ԅ^(q��)��Ŀ��(bi��o)�K�˺������K�˵�����; �����o����(sh��)��(j��)��������Ӗ(x��n)���挍(sh��)��(sh��)��(j��)�Єe��, �ԅ^(q��)���挍(sh��)��(sh��)��(j��)�����ɔ�(sh��)��(j��). ԓģ���܉����ؽ�e��ͬ�r(sh��)���ɔ_ģ�͵�����Ӗ(x��n)���^��, �����ֶθ����[��. �������������е������R(sh��)�e�h(hu��n)��(ji��)���O(sh��)���ķ���(w��)��֪�Ը��ֲ�����(sh��)����(du��)��(y��ng)�ĽK������, ����K�������ς�����(sh��)�t����ʧЧ. ᘌ�(du��)�ˆ��}, Song ����[25]���� Orekondy ����[33]��朽ӹ���˼��, �M(j��n)һ������������h(hu��n)���µ� mGAN-AI ����ģ��. ���\��(sh��)�����ķ���(w��)������(j��)�K���ς�����������(sh��)���Ɍ�(du��)��(y��ng)�ą���(sh��)��ʾ (parameter representative), ͨ�^������݆�����Ѕ���(sh��)��ʾ�c��һ݆�����Ѕ���(sh��)��ʾ�����ƶ��M(j��n)��ƥ��, ���Ƶą���(sh��)��ʾ������ͬһ��(g��)�K��. ��ʹ����(sh��)��ʾ����ȫ��ر����˴θ���, ����(sh��)��ʾ��Ӌ(j��)���ɽK���ݶȺͽK��ģ�ͅ���(sh��)ͬ�r(sh��)���c���. ���˜�(zh��n)�_��������(sh��)��ʾ�����ƶȵ�ͬ�r(sh��)���ɺ��m�ĽK�����ݱ�ʾ(identification representative), �������o����Ӗ(x��n)�����e�\���W(w��ng)�j(lu��)�ں������R(sh��)�e������ƥ��ɂ�(g��)Ӗ(x��n)��Ŀ��(bi��o), �ԌW(xu��)��(x��)���Ѕ^(q��)�ֶȵĽK�����ݱ�ʾ.ԓģ���܉����������µĭh(hu��n)�����R(sh��)�e�K���ς��ą���(sh��), ���ؽ��K�˵ķ����ӱ�.

��������, e�ؽ���Ȼ����һЩ����: ����, ������߀ԭĿ��(bi��o)e�еIJ�ͬ�ӱ�, ֻ�m����һ��(g��)e�еĘӱ�����ƵĈ���, ���ܫ@ȡ��������Ϣ����; ���, �������Ɍ�(du��)���W(w��ng)�j(lu��)���ؽ���ʽ��(du��)�����ߵ�Ӌ(j��)������Ҫ���^��, ���֙C(j��)�K�˵Ȉ����²����m��. ——Փ�����ߣ�